Actualisation automatique des tables de répertoire pour le stockage Blob Azure¶

Cette rubrique fournit des instructions pour la création de tables de répertoire et l’actualisation automatique des métadonnées de la table de répertoire à l’aide des notifications Microsoft Azure Event Grid pour un conteneur Azure. Cette opération synchronise les métadonnées avec le dernier ensemble de fichiers associés de la zone de préparation et du chemin externes, à savoir :

Les nouveaux fichiers dans le chemin sont ajoutés aux métadonnées de la table.

Les modifications apportées aux fichiers dans le chemin sont mises à jour dans les métadonnées de la table.

Les fichiers qui ne figurent plus dans le chemin sont supprimés des métadonnées de la table.

Snowflake prend en charge les types de comptes de stockage Blob suivants :

Stockage d’objets blob

Data Lake Storage Gen2

Usage général v2

L’actualisation automatique n’est pas prise en charge pour Microsoft Fabric OneLake.

Note

Seuls les événements Microsoft.Storage.BlobCreated et Microsoft.Storage.BlobDeleted déclenchent des actualisations pour les tables de répertoire. L’ajout de nouveaux objets au stockage Blob déclenche ces événements. Renommer un répertoire ou un objet ne déclenche pas ces événements. Snowflake recommande de n’envoyer que des événements pris en charge pour les tables de répertoire afin de réduire les coûts, le bruit des événements et la latence.

Snowflake prend en charge les APIs Microsoft.Storage.BlobCreated suivantes :

CopyBlobPutBlobPutBlockListFlushWithCloseSftpCommit

Snowflake prend en charge les APIs Microsoft.Storage.BlobDeleted suivantes :

DeleteBlobDeleteFileSftpRemove

Pour les comptes de stockage Data Lake Storage Gen2, les événements Microsoft.Storage.BlobCreated sont déclenchés lorsque les clients utilisent les opérations CreateFile et FlushWithClose. Si le protocole de transfert de fichiers SSH (SFTP) est utilisé, les événements Microsoft.Storage.BlobCreated sont déclenchés par les opérations SftpCreate et SftpCommit. L’API CreateFile ou SftpCreate seule n’indique pas une validation d’un fichier dans le compte de stockage. Si le message FlushWithClose ou SftpCommit n’est pas envoyé, Snowflake n’actualise pas la table de répertoire.

Note

Pour effectuer les tâches décrites dans cette rubrique, vous devez utiliser un rôle disposant du privilège CREATE STAGE sur un schéma.

De plus, vous devez avoir un accès administratif à Microsoft Azure. Si vous n’êtes pas un administrateur Azure, demandez à votre administrateur Azure d’effectuer ces étapes dans Étape 1 : Configurer l’abonnement à Event Grid.

Snowflake ne prend en charge que le schéma d’événement Azure Event Grid ; il ne prend pas en charge le schéma CloudEvents avec Azure Event Grid.

Prise en charge de la plateforme Cloud¶

Le déclenchement d’actualisations automatisées à l’aide de messages Azure Event Grid est pris en charge pour les comptes Snowflake hébergés sur l’une des plateformes cloud prises en charge.

Configuration de l’accès sécurisé au stockage Cloud¶

Note

Si vous avez déjà configuré un accès sécurisé au conteneur de stockage blob Azure qui stocke vos fichiers de données, vous pouvez ignorer cette section.

Cette section décrit comment configurer un objet d’intégration de stockage Snowflake pour déléguer la responsabilité de l’authentification pour le stockage dans le Cloud à une entité Gestion des identités et des accès Snowflake (IAM).

Note

Nous vous recommandons vivement cette option, qui vous évite de fournir des informations d’identification IAM lors de l’accès à un stockage dans le Cloud. Voir Configure an Azure container for loading data pour des options d’accès au stockage supplémentaires.

Cette section décrit comment utiliser des intégrations de stockage pour permettre à Snowflake de lire et d’écrire des données dans un conteneur Azure référencé dans une zone de préparation externe (Azure). Les intégrations sont des objets Snowflake de première classe nommés, qui évitent de transmettre des informations d’identification explicites de fournisseur Cloud, telles que des clés secrètes ou des jetons d’accès. Les objets d’intégration stockent un ID d’utilisateur Azure de gestion des identités et des accès (IAM) appelé inscription d’application. Un administrateur de votre organisation accorde à cette application les autorisations nécessaires dans le compte Azure.

Une intégration peut également spécifier des conteneurs (et des chemins facultatifs) qui limitent les emplacements que les utilisateurs peuvent spécifier lors de la création de zones de préparation externes utilisant l’intégration.

Note

La réalisation des instructions de cette section nécessite des autorisations dans Azure pour gérer les comptes de stockage. Si vous n’êtes pas un administrateur Azure, demandez à votre administrateur Azure d’effectuer ces tâches.

Dans cette section :

Étape 1 : Création d’une intégration de stockage cloud dans Snowflake¶

Créez une intégration de stockage à l’aide de la commande CREATE STORAGE INTEGRATION. Une intégration de stockage est un objet Snowflake qui stocke un principal de service généré pour votre stockage Cloud Azure, ainsi qu’un ensemble facultatif d’emplacements de stockage autorisés ou bloqués (c’est-à-dire des conteneurs). Les administrateurs de fournisseur de Cloud de votre entreprise accordent des autorisations sur les emplacements de stockage au principal de service généré. Cette option permet aux utilisateurs d’éviter de fournir des informations d’identification lors de la création de zones de préparation ou du chargement de données.

Une seule intégration de stockage peut prendre en charge plusieurs zones de préparation externes (c’est-à-dire Azure). L’URL dans la définition de zone de préparation doit correspondre aux conteneurs Azure (et aux chemins facultatifs) spécifiés pour le paramètre STORAGE_ALLOWED_LOCATIONS.

Note

Seuls les administrateurs de compte (utilisateurs dotés du rôle ACCOUNTADMIN) ou un rôle disposant du privilège global CREATE INTEGRATION peuvent exécuter cette commande SQL.

Où :

integration_nameest le nom de la nouvelle intégration.tenant_idest l’ID de votre client Office 365 auquel appartiennent les comptes de stockage autorisés et bloqués. Une intégration de stockage peut s’authentifier auprès d’un seul client. Les emplacements de stockage autorisés et bloqués doivent donc faire référence aux comptes de stockage qui appartiennent tous à ce client.Pour trouver votre ID de client, connectez-vous au portail Azure et cliquez sur Azure Active Directory » Properties. L” ID de client s’affiche dans le champ Tenant ID.

containerest le nom d’un conteneur Azure qui stocke vos fichiers de données (par exemple,mycontainer). Les paramètres STORAGE_ALLOWED_LOCATIONS et STORAGE_BLOCKED_LOCATIONS limitent ou bloquent l’accès à ces conteneurs, respectivement, lors de la création ou de la modification de zones de préparation faisant référence à cette intégration.pathest un chemin facultatif qui peut être utilisé pour fournir un contrôle granulaire sur les répertoires logiques du conteneur.

L’exemple suivant crée une intégration qui limite explicitement les zones de préparation externes utilisant l’intégration pour faire référence à l’un des deux conteneurs et des chemins. Dans une étape ultérieure, nous allons créer une zone de préparation externe qui fait référence à l’un de ces conteneurs et chemins. Plusieurs zones de préparation externes qui utilisent cette intégration peuvent référencer les conteneurs et les chemins autorisés :

Étape 2 : Accorder un accès à Snowflake aux emplacements de stockage¶

Exécutez la commande DESCRIBE INTEGRATION pour récupérer l’URL de consentement :

Où :

integration_nameest le nom de l’intégration créée à l” étape 1 : Création d’une intégration Cloud Storage dans Snowflake.

Notez les valeurs dans les colonnes suivantes :

- AZURE_CONSENT_URL:

URL vers la page de demande d’autorisations de Microsoft.

- AZURE_MULTI_TENANT_APP_NAME:

Nom de l’application client Snowflake créée pour votre compte. Plus loin dans cette section, vous devrez accorder à cette application les autorisations nécessaires pour obtenir un jeton d’accès sur vos emplacements de stockage autorisés.

Dans un navigateur Web, accédez à l’URL dans la colonne AZURE_CONSENT_URL . La page affiche une page de demande d’autorisations Microsoft.

Cliquez sur le bouton Accept. Cette action permet au principal du service Azure créé pour votre compte Snowflake d’obtenir un jeton d’accès sur des ressources spécifiées à l’intérieur de votre client. L’obtention d’un jeton d’accès ne réussit que si vous accordez au principal du service les autorisations appropriées sur le conteneur (voir l’étape suivante).

La page de demande d’autorisations Microsoft redirige vers le site d’entreprise de Snowflake (snowflake.com).

Connectez-vous au portail Microsoft Azure.

Accédez à Azure Services » Storage Accounts. Cliquez sur le nom du compte de stockage auquel vous accordez l’accès au principal du service Snowflake.

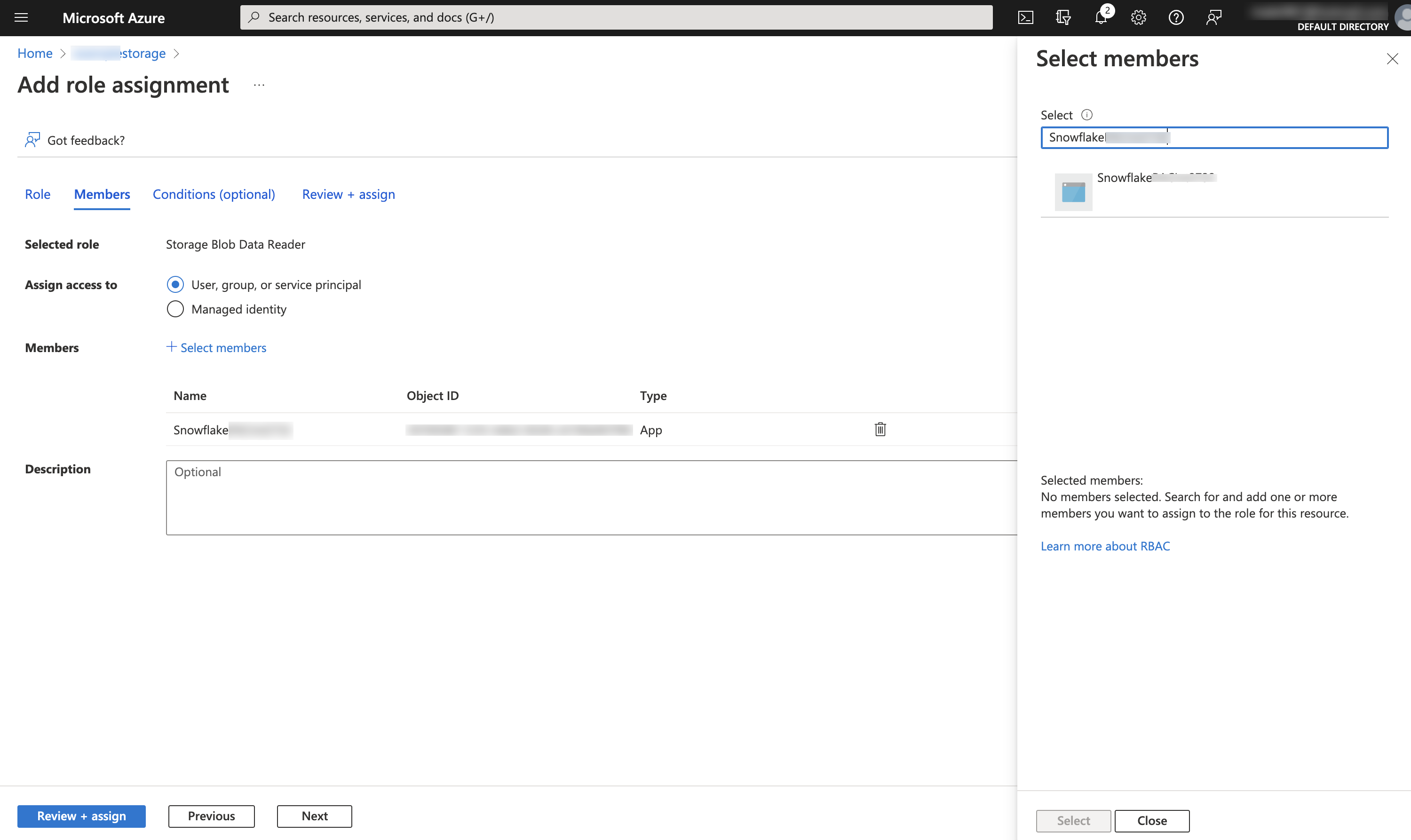

Cliquez sur Access Control (IAM) » Add role assignment.

Sélectionnez le rôle souhaité à accorder au principal du service Snowflake :

Storage Blob Data Readeraccorde un accès en lecture uniquement. Cela permet de charger des données à partir de fichiers mis en zone de préparation dans le compte de stockage.Storage Blob Data Contributoraccorde un accès en lecture et en écriture. Cela permet de charger ou de décharger des données dans des fichiers en zone de préparation dans le compte de stockage. Le rôle permet également d’exécuter la commande REMOVE pour supprimer des fichiers en zone de préparation dans le compte de stockage.

Recherchez le principal de service Snowflake. Il s’agit de l’identité de la propriété AZURE_MULTI_TENANT_APP_NAME dans la sortie DESC STORAGE INTEGRATION (à l’étape 1). Recherchez la chaîne avant le trait de soulignement dans la propriété AZURE_MULTI_TENANT_APP_NAME.

Important

Azure peut prendre une heure ou plus pour créer le principal de service Snowflake demandé via la page de demande Microsoft dans cette section. Si le principal de service n’est pas disponible immédiatement, nous vous recommandons d’attendre une heure ou deux, puis de relancer la recherche.

Si vous supprimez le principal de service, l’intégration de stockage cesse de fonctionner.

Cliquez sur le bouton Review + assign.

Note

Selon la documentation de Microsoft Azure, les affectations de rôles peuvent prendre jusqu’à cinq minutes pour se propager.

Snowflake met en cache les informations d’identification temporaires pendant une période qui ne peut dépasser le délai d’expiration de 60 minutes. Si vous révoquez l’accès à partir de Snowflake, les utilisateurs pourraient être en mesure de répertorier les fichiers et de charger des données à partir de l’emplacement de stockage dans le Cloud jusqu’à l’expiration du cache.

Note

Vous pouvez utiliser la fonction SYSTEM$VALIDATE_STORAGE_INTEGRATION pour valider la configuration de votre intégration de stockage.

Configuration de l’automatisation avec Azure Event Grid¶

Étape 1 : Configurer l’abonnement à Event Grid¶

Cette section explique comment configurer un abonnement à Event Grid pour les événements Azure Storage à l’aide d’Azure CLI. Pour plus d’informations sur les étapes décrites dans cette section, consultez les articles suivants dans la documentation Azure :

https://docs.microsoft.com/en-us/azure/event-grid/custom-event-to-queue-storage

https://docs.microsoft.com/en-us/azure/storage/blobs/storage-blob-event-quickstart

Création d’un groupe de ressources¶

Un sujet Event Grid fournit un point de terminaison où la source (c’est-à-dire Azure Storage) envoie des événements. Un sujet est utilisé pour une collection d’événements connexes. Les sujets Event Grid sont des ressources Azure et doivent être placés dans un groupe de ressources Azure.

Exécutez la commande suivante pour créer un groupe de ressources :

Où :

resource_group_nameest le nom du nouveau groupe de ressources.locationest l’emplacement ou la région dans la terminologie Snowflake de votre compte Azure Storage.

Activation du fournisseur de ressources Event Grid¶

Exécutez la commande suivante pour inscrire le fournisseur de ressources d’Event Grid. Notez que cette étape n’est requise que si vous n’avez pas déjà utilisé Event Grid avec votre compte Azure :

Création d’un compte de stockage pour les fichiers de données¶

Exécutez la commande suivante pour créer un compte de stockage pour stocker vos fichiers de données. Ce compte doit être un compte de stockage Blob (c’est-à-d. du type BlobStorage) ou GPv2 (c’est-à-d. du type StorageV2), car seuls ces deux types de compte prennent en charge les messages d’événement.

Note

Si vous avez déjà un stockage Blob ou un compte GPv2, vous pouvez utiliser ce compte à la place.

Par exemple, créez un compte de stockage Blob :

Où :

resource_group_nameest le nom du groupe de ressources que vous avez créé dans Créer un groupe de ressources.storage_account_nameest le nom du nouveau compte de stockage.locationcorrespond à l’emplacement de votre compte Azure Storage.

Créatin d’un compte de stockage pour la file d’attente de stockage¶

Exécutez la commande suivante pour créer un compte de stockage pour héberger votre file d’attente de stockage. Ce compte doit être un compte GPv2, car seul ce type de compte prend en charge les messages d’événement dans une file d’attente de stockage.

Note

Si vous avez déjà un compte GPv2, vous pouvez utiliser ce compte pour héberger à la fois vos fichiers de données et votre file d’attente de stockage.

Par exemple, créez un compte GPv2 :

Où :

resource_group_nameest le nom du groupe de ressources que vous avez créé dans Création d’un groupe de ressources.storage_account_nameest le nom du nouveau compte de stockage.locationcorrespond à l’emplacement de votre compte Azure Storage.

Création d’une file d’attente de stockage¶

Une seule file d’attente Azure Queue Storage peut collecter les messages d’événement pour de nombreux abonnements à Event Grid. Pour optimiser les performances, Snowflake recommande de créer une seule file d’attente de stockage afin de prendre en charge tous vos abonnements liés à Snowflake.

Exécutez la commande suivante pour créer une file d’attente de stockage. Une file d’attente de stockage stocke un ensemble de messages, en l’occurrence des messages d’événement d’Event Grid :

Où :

storage_queue_nameest le nom de la nouvelle file d’attente de stockage.storage_account_nameest le nom du compte de stockage que vous avez créé dans Création d’un compte de stockage pour la file d’attente de stockage.

Exportation du compte de stockage et des IDs de file d’attente à titre de référence¶

Exécutez les commandes suivantes pour définir les variables d’environnement des IDs de compte de stockage et de file d’attente qui seront demandés ultérieurement dans ces instructions :

Linux ou macOS :

Windows :

Où :

data_storage_account_nameest le nom du compte de stockage que vous avez créé dans Créer un compte de stockage pour les fichiers de données.queue_storage_account_nameest le nom du compte de stockage que vous avez créé dans Création d’un compte de stockage pour la file d’attente de stockage.resource_group_nameest le nom du groupe de ressources que vous avez créé dans Création d’un groupe de ressources.storage_queue_nameest le nom de la file d’attente de stockage que vous avez créée dans Création d’une file d’attente de stockage.

Installation de l’extension Event Grid¶

Exécutez la commande suivante pour installer l’extension Event Grid pour Azure CLI :

Création de l’abonnement à Event Grid¶

Exécutez la commande suivante pour créer l’abonnement à Event Grid. L’abonnement à un sujet indique à Event Grid quels événements doivent être suivis :

Linux ou macOS :

Windows :

Où :

storageidetqueueidsont les variables d’environnement des ID de compte de stockage et de file d’attente que vous avez définis dans Exportation des IDs du compte de stockage et de la file d’attente à titre de référence.subscription_nameest le nom du nouvel abonnement à Event Grid.

Étape 2 : Créer l’intégration des notifications¶

Une intégration de notification est un objet Snowflake qui fournit une interface entre Snowflake et un service de mise en file d’attente de messages dans le Cloud tiers, tel que Azure Event Grid.

Note

Une seule intégration de notification prend en charge une seule file d’attente de stockage Azure. Le fait de référencer la même file d’attente de stockage dans plusieurs intégrations de notification peut entraîner des données manquantes dans les tables cibles, car les notifications d’événements sont réparties entre les intégrations de notification.

Récupération de l’URL de la file d’attente de stockage et de l’ID client¶

Connectez-vous au portail Microsoft Azure.

Accédez à Storage account » Queue service » Queues. Enregistrez l’URL pour la file d’attente que vous avez créée dans Créer une file d’attente de stockage pour référence ultérieure. L’URL a le format suivant :

Accédez à Azure Active Directory » Properties. Enregistrez la valeur Tenant ID pour référence plus tard. L’ID de répertoire , ou ID de client, est nécessaire pour générer l’URL de consentement qui accorde à Snowflake l’accès à l’abonnement à Event Grid.

Créer l’intégration des notifications¶

Créez une intégration de notification à l’aide de la commande CREATE NOTIFICATION INTEGRATION.

Note

Seuls les administrateurs de compte (utilisateurs dotés du rôle ACCOUNTADMIN) ou un rôle disposant du privilège global CREATE INTEGRATION peuvent exécuter cette commande SQL.

Le principal du service Azure pour les intégrations de notification est différent du principal de service créé pour les intégrations de stockage.

Où :

integration_nameest le nom de la nouvelle intégration.queue_URLetdirectory_IDsont l’URL de la file d’attente et l’ID client que vous avez enregistrés dans Récupération de l’URL de la file d’attente de stockage et l’ID client.

Par exemple :

Octroi de l’accès de Snowflake à la file d’attente de stockage¶

Notez que certaines étapes de cette section nécessitent une installation locale du logiciel Azure CLI.

Exécutez la commande DESCRIBE INTEGRATION pour récupérer l’URL de consentement :

Où :

integration_nameest le nom de l’intégration que vous avez créée dans Création de l’intégration des notifications.

Notez les valeurs dans les colonnes suivantes :

- AZURE_CONSENT_URL:

URL vers la page de demande d’autorisations de Microsoft.

- AZURE_MULTI_TENANT_APP_NAME:

Nom de l’application client Snowflake créée pour votre compte. Plus loin dans cette section, vous devrez accorder à cette application les autorisations nécessaires pour obtenir un jeton d’accès sur votre sujet autorisé.

Dans un navigateur Web, accédez à l’URL dans la colonne AZURE_CONSENT_URL . La page affiche une page de demande d’autorisations Microsoft.

Cliquez sur le bouton Accept. Cette action permet au principal du service Azure créé pour votre compte Snowflake d’obtenir un jeton d’accès sur n’importe quelle ressource à l’intérieur de votre client. L’obtention d’un jeton d’accès ne réussit que si vous accordez au principal du service les autorisations appropriées sur le conteneur (voir l’étape suivante).

La page de demande d’autorisations Microsoft redirige vers le site d’entreprise de Snowflake (snowflake.com).

Connectez-vous au portail Microsoft Azure.

Accédez à Azure Active Directory » Enterprise applications. Vérifiez que l’identificateur de l’application Snowflake que vous avez enregistré à l’étape 2 de cette section est répertorié.

Important

Si vous supprimez l’application Snowflake dans Azure Active Directory plus tard, l’intégration des notifications cesse de fonctionner.

Accédez à Queues »

storage_queue_name, oùstorage_queue_nameest le nom de la file d’attente de stockage que vous avez créée dans Créer une file d’attente de stockage.Cliquez sur Access Control (IAM) » Add role assignment.

Recherchez le principal de service Snowflake. Il s’agit de l’identité de la propriété AZURE_MULTI_TENANT_APP_NAME dans la sortie DESC NOTIFICATION INTEGRATION (à l’étape 1). Recherchez la chaîne avant le trait de soulignement dans la propriété AZURE_MULTI_TENANT_APP_NAME.

Important

Azure peut prendre une heure ou plus pour créer le principal de service Snowflake demandé via la page de demande Microsoft dans cette section. Si le principal de service n’est pas disponible immédiatement, nous vous recommandons d’attendre une heure ou deux, puis de relancer la recherche.

Si vous supprimez le principal de service, l’intégration de notification cesse de fonctionner.

Accordez à l’application Snowflake les autorisations suivantes :

Role: Processeur de messages pour les données de la file d’attente de stockage (le rôle minimum requis), ou Contributeur de données de la file d’attente de stockage.

Assign access to: Principal de service, groupe ou utilisateur AD Azure.

Select: La valeur

appDisplayName.

L’identificateur de l’application Snowflake devrait maintenant figurer dans la liste sous Storage Queue Data Message Processor ou Storage Queue Data Contributor (dans la même boîte de dialogue).

Étape 3 : Création d’une zone de préparation incluant une table de répertoire¶

Créez une zone de préparation externe qui fait référence à votre conteneur Azure à l’aide de la commande CREATE STAGE. Snowflake lit vos fichiers de données en zone de préparation dans les métadonnées de la table de répertoire. Vous pouvez aussi utiliser une zone de préparation externe existante.

Note

Pour configurer un accès sécurisé à l’emplacement de stockage Cloud, voir Configuration de l’accès sécurisé au stockage Cloud (dans cette rubrique).

Pour faire référence à une intégration de stockage dans l’instruction CREATE STAGE, le rôle doit avoir le privilège USAGE sur l’objet d’intégration de stockage.

Où :

Paramètres de la table de répertoire (directoryTable)¶

ENABLE = TRUE | FALSESpécifie s’il faut ajouter une table de répertoire à la zone de préparation. Lorsque la valeur est TRUE, une table de répertoire est créée avec la zone de préparation.

Par défaut :

FALSEAUTO_REFRESH = TRUE | FALSESpécifie si Snowflake doit activer le déclenchement des actualisations automatiques des métadonnées de la table de répertoire lorsque de nouveaux fichiers de données ou des fichiers de données mis à jour sont disponibles dans la zone de préparation externe nommée spécifiée dans la valeur d’URL.

TRUESnowflake permet de déclencher des actualisations automatiques des métadonnées de la table de répertoire.

FALSESnowflake n’active pas le déclenchement d’actualisations automatiques des métadonnées de la table de répertoire. Vous devez actualiser manuellement les métadonnées de la table de répertoire de façon périodique avec ALTER STAGE … REFRESH pour synchroniser les métadonnées avec la liste actuelle des fichiers dans le chemin de la zone de préparation.

Par défaut :

FALSE

Microsoft Azure

NOTIFICATION_INTEGRATION = '<notification_integration_name>'Spécifie le nom de l’intégration de notification utilisée pour actualiser automatiquement les métadonnées de la table de répertoire à l’aide des notifications Azure Event Grid. Une intégration de notification est un objet Snowflake qui fournit une interface entre Snowflake et des services tiers de mise en file d’attente de messages dans le Cloud.

L’exemple suivant crée une zone de préparation nommée mystage dans le schéma actif de la session utilisateur. L’URL de stockage Cloud inclut le chemin files. La zone de préparation fait référence à une intégration de stockage nommée my_storage_int.

Note

Utilisez le point de terminaison

blob.core.windows.netpour tous les types de comptes de stockage Azure Blob pris en charge, dont Data Lake Storage Gen2.L’emplacement de stockage dans la valeur d’URL doit se terminer par une barre oblique (

/).

Le paramètre NOTIFICATION_INTEGRATION fait référence à l’intégration my_notification_int créée à l’Étape 2 : Créer l’intégration des notifications. Le nom de l’intégration doit être fourni en majuscule.

Lorsque des fichiers de données nouveaux ou mis à jour sont ajoutés à l’emplacement de stockage dans le Cloud, la notification d’événement demande à Snowflake de les analyser dans les métadonnées de la table de répertoire.

Étape 4 : Actualisation manuelle des métadonnées d’une table de répertoire¶

Actualiser manuellement les métadonnées d’une table de répertoire à l’aide de la commande ALTER STAGE.

Syntaxe¶

Où :

REFRESHAccède aux fichiers de données mis en zone de préparation, et référencés dans la définition de table de répertoire et met à jour les métadonnées de la table :

Les nouveaux fichiers dans le chemin sont ajoutés aux métadonnées de la table.

Les modifications apportées aux fichiers dans le chemin sont mises à jour dans les métadonnées de la table.

Les fichiers qui ne figurent plus dans le chemin sont supprimés des métadonnées de la table.

Actuellement, il est nécessaire d’exécuter cette commande chaque fois que des fichiers sont ajoutés à la zone de préparation, mis à jour ou détruits. Cette étape synchronise les métadonnées avec le dernier ensemble de fichiers associés dans la définition de la zone de préparation pour la table de répertoire.

SUBPATH = '<relative-path>'Spécifiez éventuellement un chemin relatif pour actualiser les métadonnées pour un sous-ensemble spécifique des fichiers de données.

Exemples¶

Actualiser manuellement les métadonnées de la table de répertoire dans une zone de préparation nommée mystage :

Important

Si cette étape n’est pas réalisée avec succès au moins une fois après la création de la table de répertoire, l’interrogation de la table de répertoire ne renvoie aucun résultat jusqu’à ce qu’un événement de notification déclenche l’actualisation automatique des métadonnées de la table de répertoire pour la première fois.

Étape 5 : configurer la sécurité¶

Pour chaque rôle supplémentaire qui sera utilisé pour interroger la table de répertoire, accordez des privilèges de contrôle d’accès suffisants sur les différents objets (c.-à-d. la ou les bases de données, le ou les schémas, la zone de préparation et la table) avec GRANT <privilèges> … TO ROLE :

Objet |

Privilège |

Remarques |

|---|---|---|

Base de données |

USAGE |

|

Schéma |

USAGE |

|

Zone de préparation nommée |

USAGE , READ |

|

Format de fichier nommé |

USAGE |

Facultatif ; uniquement nécessaire si la zone de préparation que vous avez créée fait référence à un format de fichier nommé. |