Cortex AI Functions: Images¶

Mit Cortex AI Images können Sie Folgendes erreichen:

Bilder vergleichen

Bilder beschriften

Bilder klassifizieren

Entitäten aus Bildern extrahieren

Einbettungsvektoren zur Verwendung in Abrufsystemen generieren

Fragen mithilfe von Daten in Graphen und Diagrammen beantworten

Sie können diese Aufgaben mit den folgenden Funktionen erledigen:

Eingabeanforderungen¶

COMPLETE Multimodal kann Bilder mit den folgenden Merkmalen verarbeiten:

Anforderung |

Wert |

|---|---|

Dateinamen-Erweiterungen |

|

Stagingbereich-Verschlüsselung |

Serverseitige Verschlüsselung: |

Datentyp |

Bemerkung

Die Verarbeitung von Dateien aus Stagingbereichen ist derzeit nicht mit benutzerdefinierten Netzwerkrichtlinien kompatibel.

Bilder analysieren¶

Die COMPLETE-Funktion verarbeitet ein einzelnes Bild oder mehrere Bilder (z. B. um Unterschiede in Entitäten zwischen verschiedenen Bildern zu extrahieren), die in einem Stagingbereich gespeichert sind. Unter Stagingbereich für Mediendateien erstellen finden Sie Informationen zur Erstellung eines passenden Stagingbereichs.

Der Funktionsaufruf gibt Folgendes an:

Das zu verwendende multimodale Modell

Eine Aufforderung

Den Pfad des Stagingbereichs der Bilddatei(en) über ein FILE-Objekt

Beispiel für Vision-Fragen und -Antworten¶

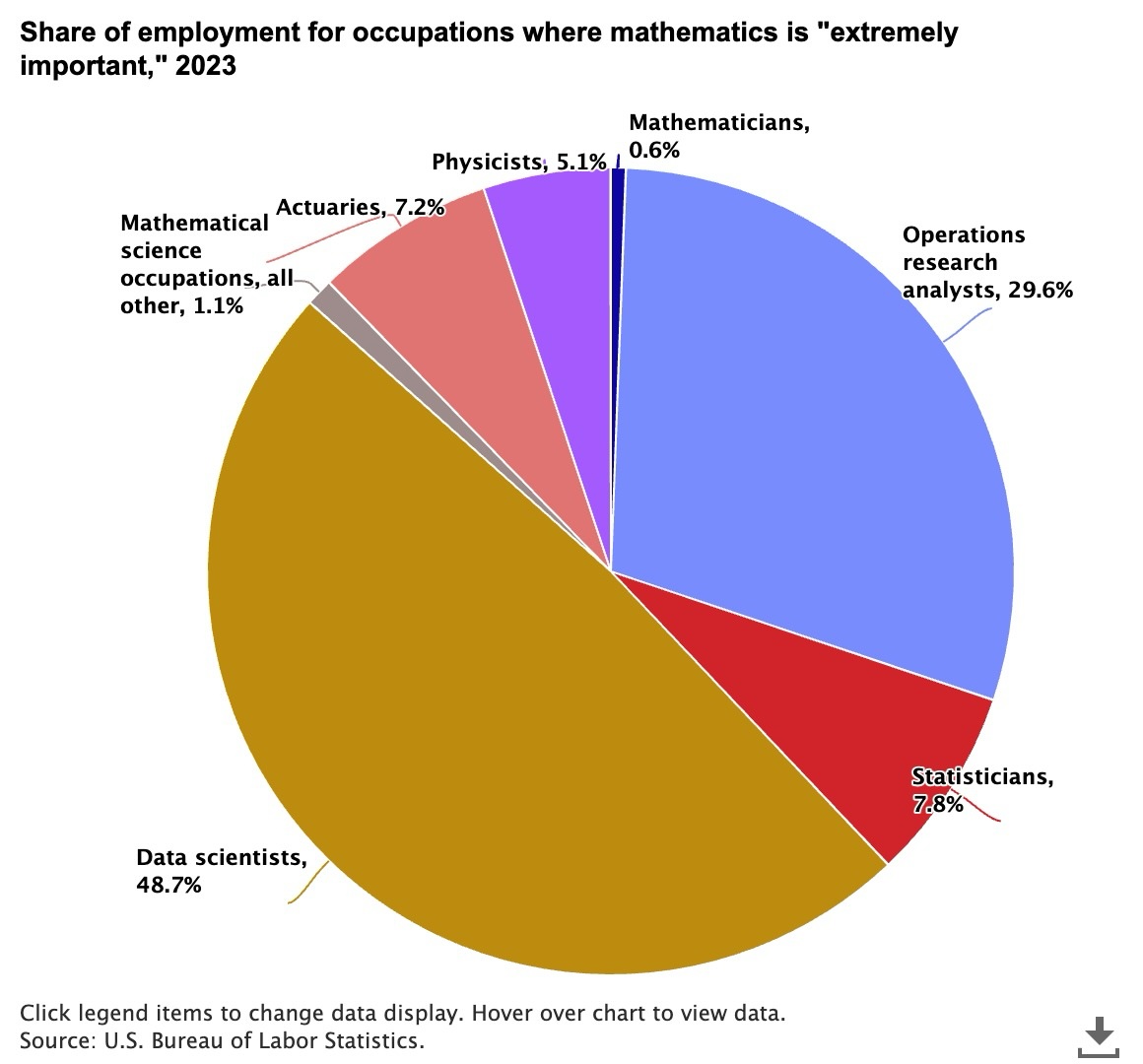

The following example uses Anthropic’s Claude Sonnet 4.6 model to summarize a pie chart science-employment-slide.jpeg stored in the @myimages stage.

Die Verteilung der Berufe, in denen Mathematik im Jahr 2023 als „extrem wichtig“ angesehen wird¶

Antwort:

Beispiel für Vergleich von Bildern¶

Bemerkung

Derzeit können nur die Modelle Anthropic (claude) und Meta (llama) mehrere Bilder in einer einzigen Eingabeaufforderung referenzieren. Die Unterstützung mehrerer Bilder für andere Modelle wird möglicherweise in einer zukünftigen Release verfügbar sein.

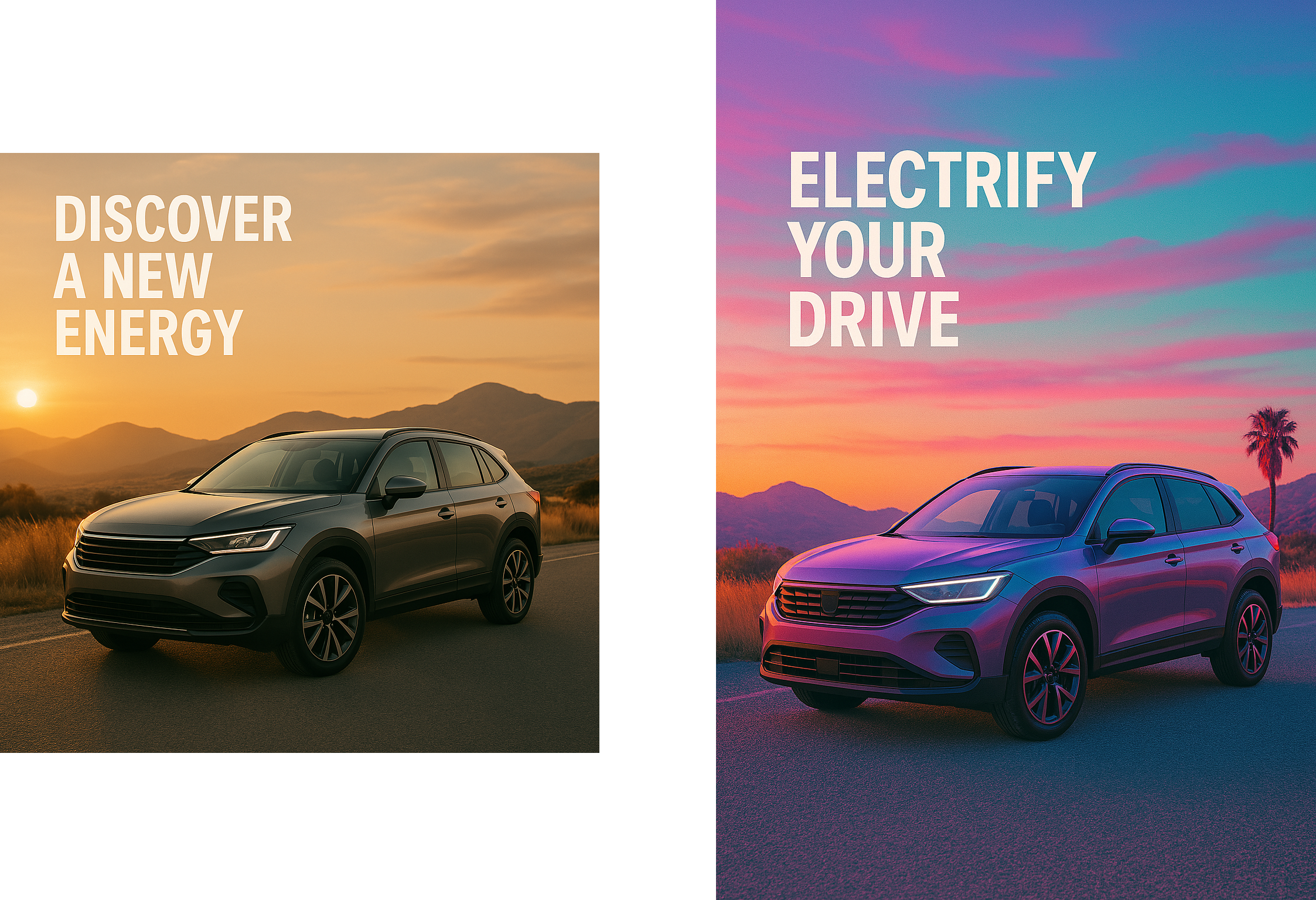

Use the PROMPT helper function to process multiple images in a single COMPLETE call. The following example uses

Anthropic’s Claude Sonnet 4.6 model to compare two different ad creatives from the @myimages stage.

Bild von zwei Anzeigen für Elektroautos¶

Antwort:

Beispiel zum Klassifizieren von Bildern¶

Im folgenden Beispiel wird AI_CLASSIFY verwendet, um ein Bild für eine Immobilienanwendung zu klassifizieren.

Das folgende SQL verwendet die AI_CLASSIFY-Funktion, um das Bild als Foto eines Wohnbereichs, einer Küche, eines Badezimmers, eines Gartens oder eines Hauptschlafzimmers zu klassifizieren.

Antwort:

Das SQL unten kategorisiert die im obigen Bild gefundenen Objekte als Sofa, Fenster, Tisch, Fernseher oder Kunstgegenstand.

Antwort:

Bilder durchsuchen¶

Sie können AI_EMBED verwenden, um Bilder zu finden, die einem Zielbild ähnlich sind. Verwenden Sie zuerst die Funktion AI_EMBED, um einen Einbettungsvektor für das Zielbild zu generieren, der dessen visuelle Features in einen abstrakten Vektorraum abbildet, eine numerische Darstellung der Features des Bildes. Sie können dann Vektorähnlichkeitsfunktionen verwenden, um diesen Einbettungsvektor mit den Einbettungsvektoren anderer Bilder zu vergleichen. So erhalten Sie einen Ähnlichkeitswert auf der Grundlage ihrer gemeinsamen oder ähnlichen visuellen Features. Diese Wert kann verwendet werden, um Bilder auf der Grundlage ihrer Ähnlichkeit mit dem Zielbild zu klassifizieren, einzuordnen oder zu filtern.

In obigen Bildern sehen Sie zum Beispiel, dass das folgende SQL einen Einbettungsvektor für jedes Bild generiert und die Vektoren dann mithilfe der Cosinus-Ähnlichkeit vergleicht. Das Ergebnis von etwa 0,5 gibt an, dass die Bilder etwas ähnlich sind. Beide Fotos wurden in einer städtischen Umgebung aufgenommen und enthalten eine Menge Menschen im Hintergrund, die Hauptobjekte unterscheiden sich aber.

Um Bilder zu finden, die einem Zielbild ähnlich sind, können Sie AI_SIMILARITY verwenden. Das folgende Beispiel berechnet einen Ähnlichkeitswert für ggf. Tausende von Bildern und gibt die Werbeanzeigen zurück, die der unten stehenden Motorradwerbung am ähnlichsten sind.

Die Abfrage gibt Bilder aus einer multimodalen Tabelle zurück, bei denen der Ähnlichkeitswert größer als 0,50 ist. Eines der identifizierten Bilder (image_226.jpg) ist das, welches wir als Referenz verwendet haben.

Modellbeschränkungen¶

All models available to Snowflake Cortex have limitations on the total number of input and output tokens, known as the model’s context window. The context window size is measured in tokens. Inputs exceeding the context window limit result in an error. Output which would exceed the context window limit is truncated.

Bei Textmodellen entsprechen Token in der Regel etwa vier Zeichen Text, so dass die Wortanzahl, die einem Limit entspricht, geringer ist als die Anzahl der Token.

Bei Bildmodellen hängt die Anzahl der Token pro Bild von der Architektur des Bildmodells ab. Token innerhalb einer Eingabeaufforderung (z. B. „Welches Tier ist das?“) tragen ebenfalls zum Kontextfenster des Modells bei.

Modell |

Kontextfenster (Token) |

Dateitypen |

Dateigröße |

Bilder pro Aufforderung |

|---|---|---|---|---|

|

1,047,576 |

.jpg, .jpeg, .png, .webp, .gif |

10MB |

5 |

|

200,000 |

.jpg, .jpeg, .png, .webp, .gif |

3,75 MB [L1] |

20 |

|

200,000 |

.jpg, .jpeg, .png, .webp, .gif |

3,75 MB [L1] |

20 |

|

200,000 |

.jpg, .jpeg, .png, .webp, .gif |

3,75 MB [L1] |

20 |

|

200,000 |

.jpg, .jpeg, .png, .webp, .gif |

3,75 MB [L1] |

20 |

|

128,000 |

.jpg, .jpeg, .png, .webp, .gif, .bmp |

10 MB |

10 |

|

128,000 |

.jpg, .jpeg, .png, .webp, .gif, .bmp |

10 MB |

10 |

|

128,000 |

.jpg, .jpeg, .png, .webp, .gif, .bmp |

10 MB |

1 |

|

32,768 |

.jpg, .png, .pg, .gif, .bmp |

10 MB |

1 |

Hinweise zu Kosten¶

Die Abrechnung richtet sich nach der Anzahl der verarbeiteten Token. Die Anzahl der Token pro Bild hängt von der Architektur des Bildmodells ab.

Die Formel für anthropische Modelle (

claude) lautet in etwa: Token = (Breite in Pixel x Höhe in Pixel) / 750.Die Mistral-Modelle (

pixtral) teilen jedes Bild in Batches von 16x16 Pixeln auf und wandeln jeden Batch in ein Token um. Die Gesamtzahl der Token entspricht ungefähr (Breite in Pixel / 16) * (Höhe in Pixel / 16).Meta (

llama)-Modelle versuchen, das Bild mit quadratischen Kacheln zu kacheln. Je nach Seitenverhältnis und Größe des Bildes kann die Anzahl der Kacheln bis zu 16 betragen, die jeweils durch etwa 153 Token dargestellt werden.Open AI models rescale the image and tile it with square patches. For

openai-gpt-4.1, depending on the image ratio and size, the number of tokens can be 211 (images up to 512x512px), 352 (non-square images with longer side length 1024px), or from 630 tokens (square images at least 1024x1024px) to 913 tokens (non-square images with shorter side length 1024px).voyage-multimodal-3arbeitet mit einem Array von Bildfeldern, die etwa 14 × 14 Pixel groß sind. Das Bild wird so neu skaliert, dass es durch ein Gitter abgedeckt wird, das mindestens 64 und höchstes 2.500 Felder enthält. Es werden zwei zusätzliche Bild-Token hinzugefügt, sodass die Eingabe zwischen 66 und 2.502 Token liegt, abhängig von Bildgröße und Seitenverhältnis.

Bemerkung

Die Funktion COUNT_TOKENS unterstützt derzeit keine Bildeingaben.

Auswahl eines Bildmodells¶

Die Funktion COMPLETE unterstützt mehrere Modelle mit unterschiedlicher Leistungsfähigkeit, Latenzzeit und Kosten. Um eine optimale Leistung pro Credit zu erzielen, wählen Sie ein Modell, das auf den Umfang des Inhalts und die Komplexität der Aufgabe abgestimmt ist.

Modell |

MMMU |

Mathvista |

ChartQA |

DocVQA |

VQAv2 |

|---|---|---|---|---|---|

GPT-4o |

68,6 |

64,6 |

85,1 |

88,9 |

77,8 |

|

75,0 |

72,0 |

|||

|

73,4 |

73,7 |

90 |

94,4 |

|

|

69,4 |

70,7 |

88,8 |

94,4 |

|

|

64,0 |

69,4 |

88,1 |

85,7 |

67 |

Die Benchmarks sind:

MMMU: Bewertet multimodale Modelle bei multidisziplinären Aufgaben, die logisches Denken auf College-Niveau erfordern.

Mathvista: Benchmark für mathematisches Denken in einem visuellen Kontext.

ChartQA: Bewertet komplexe Argumentationsfragen zu Diagrammen.

DocVQA und VQv2: Benchmarks für die visuelle Beantwortung von Fragen zu Dokumenten.

Bei multimodalen Einbettungen ist nur das voyage-multimodal-3-Modell derzeit verfügbar. voyage-multimodal-3 ist ein hochmodernes multimodales Einbettungsmodell, das in der Lage ist, Text und Bilder einzubetten. Es kann wichtige visuelle Features aus Quellen wie Screenshots von PDFs, Folien, Tabellen und Abbildungen extrahieren, was den Bedarf an komplexen Workflows zum Parsen von Dokumenten reduziert. Gemäß internen Benchmarks von Voyage AI ist das Modell voyage-multimodal-3 leistungsstärker als konkurrierende Modelle wie z. B. OpenAI CLIP Large, Amazon Titan Multimodal und Cohere Multimodal v3.

Regionale Verfügbarkeit¶

Die Unterstützung für dieses Feature ist für Konten in den folgenden Snowflake-Regionen nativ verfügbar:

AI_COMPLETE ist in weiteren Regionen verfügbar über die regionenübergreifende Inferenz.

Fehlerbedingungen¶

Meldung |

Erläuterung |

|---|---|

Anfrage für externe Funktion SYSTEM$COMPLETE_WITH_IMAGE_INTERNAL mit Remotedienstfehler: 400 „Ungültiger Bildpfad“ fehlgeschlagen |

Entweder die Dateierweiterung oder die Datei selbst wird von dem Modell nicht akzeptiert. Die Meldung kann auch bedeuten, dass der Dateipfad falsch ist, d. h. dass die Datei am angegebenen Speicherort nicht existiert. Bei Dateinamen wird zwischen Groß- und Kleinschreibung unterschieden. |

Fehler in sicherem Objekt |

Kann anzeigen, dass der Stagingbereich nicht existiert. Überprüfen Sie den Namen des Stagingbereichs und stellen Sie sicher, dass der Bereich existiert und zugänglich ist. Achten Sie darauf, das at (@)-Zeichen am Anfang des Pfads zum Stagingbereich zu verwenden, z. B. |

Anfrage für externe Funktion _COMPLETE_WITH_PROMPT mit Remotedienstfehler: 400 „“invalid request parameters: unsupported image format: image/**“ fehlgeschlagen |

Unsupported image format given to |

Anfrage für externe Funktion _COMPLETE_WITH_PROMPT mit Remotedienstfehler: 400 „invalid request parameters: Image data exceeds the limit of 5.00 MB“ fehlgeschlagen |

The provided image given to |

Rechtliche Hinweise¶

Die Datenklassifizierung der Eingaben und Ausgaben ist in der folgenden Tabelle aufgeführt.

Klassifizierung von Eingabedaten |

Klassifizierung von Ausgabedaten |

Benennung |

|---|---|---|

Usage Data |

Customer Data |

Die allgemein verfügbaren Funktionen sind abgedeckte AI-Features. Die Vorschaufunktionen sind Vorschau-AI-Features. [1] |

Weitere Informationen dazu finden Sie unter KI und ML in Snowflake.